Interaktive Bekleidung auf der New Yorker Fashion Week

SAP, Cirque du Soleil und die Künstlerin Anouk Wipprecht haben auf der diesjährigen Fashion Week in New York interaktive Bekleidung gezeigt, die einmal mehr zeigt, was man sich unter Experience Management vorstellen kann.

Digitalisierung des amerikanischen Arbeitsmarkts

Die Brookings Institution hat eine Studie für den amerikanischen Arbeitsmarkt veröffentlicht, die zeigt, wie grundlegend sich viele Arbeitsplätze in den USA, und damit der Arbeitsmarkt, seit dem Jahr 2000 digitalisiert haben.

Die Welt in 2019

Ich habe am Wochenende mehrere Veranstaltungen mit dem Kolumnisten der NYTimes, Thomas L. Friedman, und dem Autor Prof. Yuval Noah Harari gesehen, die ich heute weiterempfehlen möchte.

Inhaltlich kamen sehr viele globale Trends zur Sprache, die beide teilweise auch in Ihren letzten Büchern beschreiben haben.

Robotic Process Automation

Die moderne Arbeitswelt unterliegt einem fundamentalen Wandel. Glaubt man Studien fallen in naher Zukunft viele Jobs weg, oder ändern sich fundamental. Im D!gitalist Magazin finden sich diverse Artikelserien, die diese Entwicklung verdeutlichen.

New Leadership: Anforderungen an die Führungskräfte von morgen

Die Digitalisierung der Arbeitswelt und der damit verbundene Wandel erfordern ein Umdenken von Unternehmen und Mitarbeitern.

Themen wie Agilität, lebenslanges Lernen und die sich wandelnde Rolle des Managements rücken in den Vordergrund und erweisen sich zunehmend als wettbewerbskritische Faktoren.

KI – Die neue Arbeitswelt

Die Arbeitswelt ändert sich aufgrund der fortschreitenden Digitalisierung. Da die Datenmengen stetig anwachsen, entstehen im Produktmanagement neue Anforderungen und es werden neue Kompetenzen benötigt.

Künstliche Intelligenz – Schulungsempfehlungen

Experten warnen davor, daß Deutschland und Europa aufpassen müssen, um nicht von amerikanischen und chinesischen Unternehmen auf dem Gebiet der künstlichen Intelligenz abgehängt zu werden. Aus- und Weiterbildung könnte diese Entwicklung abmildern. Heute möchte ich Ihnen einige Onlinetrainings vorschlagen.

Künstliche Intelligenz – Aufholjagd nötig

China und die USA sind die großen Player im Bereich der künstlichen Intelligenz, und viele Experten warnen davor, daß Europa und Deutschland im Begriff sind, abgehängt zu werden. Dabei hängt die zukünftige Wertschöpfung an der Frage, ob die Unternehmen den Anschluss halten können.

Nachhaltigkeit und künstliche Intelligenz

Angeregt durch einen Beitrag in Google’s „The Keyword“ Newsletter habe ich mir angesehen, was die künstliche Intelligenz im Bereich Nachhaltigkeit leisten kann, beziehungsweise schon leistet.

Trends 2019: The Global Risks Report 2019

Derzeit findet das Weltwirtschaftsforum in Davos statt. Auf der Website besteht die Möglichkeit über einen Live-Blog teilzunehmen. Es gibt aber noch weitere Möglichkeiten.

Eine wichtige Veröffentlichung ist der „Global Risk Report“. Den habe ich mir näher angeschaut.

Kreativität – Eine Buchvorstellung

Das Buch, das ich Ihnen heute kurz vorstellen möchte, habe ich im Zentrum für Kunst und Medien (ZKM) in Karlsruhe gekauft. Es behandelt ein Thema, das in der Kunst genau so wichtig ist, wie in der Produktentwicklung: Kreativität.

Onboarding: Diese typischen Fehler müssen Sie vermeiden

Die Arbeitswelt befindet sich aufgrund der fortschreitenden Digitalisierung im Wandel. Qualifizierte Mitarbeiter, die in der Lage sind, diesen Wandel zu gestalten, sind das A und O einer erfolgreichen Digitalisierungsstrategie.

Hat man einen passenden Mitarbeiter oder eine Mitarbeiterin gefunden, will man ihn möglichst schnell an das Unternehmen binden. Damit das gelingt, benötigt man funktionierende Onboarding-Prozesse.

Installation von Kubernetes auf einem Raspberry Pi Cluster

Kubernetes wird in Rechenzentren bei Cloudanbietern eingesetzt, um dort containerisierte Anwendungen zu orchestrieren.

Ein beliebtes Raspberry PI Projekt ist die Installation eines solchen Clusters auf diesen kleinen Rechnern, z.B. um damit die Funktionsweise zu erlernen ode zu testen.

Ich habe mir ein solches Cluster aufgebaut, und will es heute in groben Zügen vorstellen.

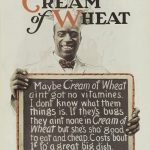

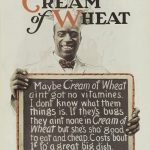

Machine Learning und Algorithmic Bias – Eine Einführung

Neulich habe ich eine Artikelserie verfolgt, in der es um die Befangenheit (Bias) in Algorithmen der Maschinenintelligenz ging, die durchaus problematisch sein kann.

IBM hat eine Softwarebibliothek veröffentlicht, die bei dieser Problematik weiterhilft, und bietet eine große Menge an weiterführenden Informationen an.

Ethik der künstlichen Intelligenz

Wenn Sie sich ein wenig mit dem Thema der künstlichen Intelligenz befassen, werden Sie schnell auf Fragestellungen stoßen, die über die reine Technologie hinausgehen oder auch über die betriebswirtschaftlichen Aspekte.

Über intelligente Algorithmen verleihen wir Maschinen menschliche Fähigkeiten, und fragen uns richtigerweise ob diese Software allen ethischen Aspekten genügt.

Industrie 4.0 – Der Wandel in der Arbeitswelt eine große Herausforderung für Beschäftigte

Das gemeinnützige Weltwirtschaftsforum hat eine Studie veröffentlicht, die zeigt, wie grundlegend sich im Zuge der Digitalisierung gerade die Arbeitsmärkte ändern.

Viele Jobs werden wegfallen, und viele Jobs werden neu entstehen. In Deutschland entsteht aufgrund dieses grundlegenden Wandels gerade ein riesiger Schulungsbedarf.

Anforderungen aus Data Science Projekten

Im Zuge der fortschreitenden Digitalisierung wenden sich immer mehr Unternehmen ihren großen Datenbeständen zu, und versuchen aus diesen Daten geschäftsrelevantes Wissen zu extrahieren. Für solche Auswertungen sind Data Scientists nötig, mit ihrem spezifischen Know How und Techniken.

Fragt sich, wo die Stolpersteine im Bereich Data Science liegen, und was solche Projekte erfolgreich macht.

Machine Learning – Erfahrungen der Fast Movers

Dafür, daß es sich derzeit um eines der meistbesprochenen fachlichen Themen in der IT handelt, blicken die Techniken des maschinellen Lernens auf eine erstaunlich lange Geschichte zurück.

Die Economist Intelligence Unit hat zusammen mit der Firma SAP eine Studie veröffentlicht, die zeigt, wie erfolgreiche Firmen diese Technologie heutzutage einsetzen.

Unternehmensgründung und Wachstum

Junge Unternehmen stehen nicht nur vor der Aufgabe, ein tragfähiges Produkt zu entwickeln, sondern sie müssen sich auch um Aspekte, wie das Marketing oder die Positionierung kümmern.

Ein praxisorientierter Guide kann hierbei helfen.

Arbeitsumgebungen für Machine Learning und Data Science

Data Science Projekte oder Machine Learningmodelle bestehen oft aus einer Vielzahl von Modellelementen oder Detailanalysen, die man zusammen betrachten muss.

In der Praxis ist es keine einfache Angelegenheit, den notwendigen Überblick zu behalten. Zwei interessante Bibliotheken füllen diese Lücke.

„Open Codes“ am ZKM und das Human Brain Project

Über die Ausstellung „Open Codes – Leben in digitalen Welten“ am ZKM in Karlsruhe bin ich auf das „Human Brain Projekt“ gestoßen.

Dieses EU-Projekt erforscht das menschliche Gehirn und Denken. Es bietet darüberhinaus eine Infrastruktur, in der man z.B. mit virtuellen Robotern experimentieren kann.

Ideenmanagement und Befragungstechniken

Innovative Produkte sind eigentlich in jeder Branche wichtig. Fragt sich, welche Organisationsform besonders innovationsfördernd ist.

Lange ging man davon aus, daß ein großes Netzwerk erforderlich ist. Eine neue Studie zeigt, daß es auch anders geht.

Ich arbeite seit vielen Jahren in der Softwareentwicklung für Unternehmensanwendungen bei der SAP SE. Dieser Blog ist privat, und die Meinungen sind meine eigenen. Sie sind hier richtig, wenn sie sich für Praxiserfahrungen im Produktmanagement für Investitionsgüter interessieren.

Ich arbeite seit vielen Jahren in der Softwareentwicklung für Unternehmensanwendungen bei der SAP SE. Dieser Blog ist privat, und die Meinungen sind meine eigenen. Sie sind hier richtig, wenn sie sich für Praxiserfahrungen im Produktmanagement für Investitionsgüter interessieren.